Investigación / A Profundidad

- Ene 02, 2024

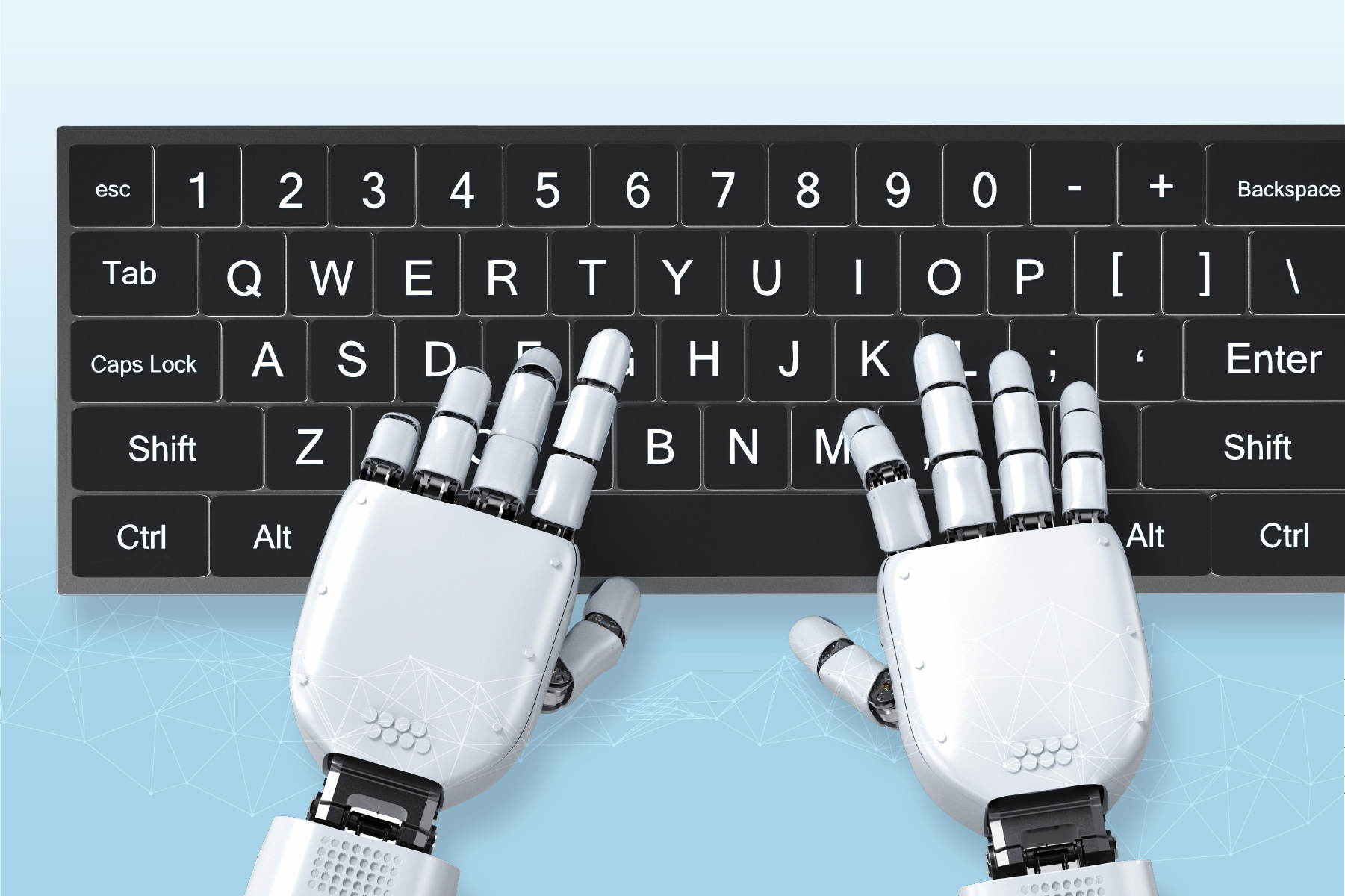

El dilema de la IA y su regulación

Después de la denominada Revolución Digital o Tercera Revolución Industrial, a mediados del siglo XX, cuando basándose en las tecnologías de la información los procesos de producción se automatizaron, aparece una Cuarta Revolución, que se centra en la digitalización completa de las operaciones de una empresa o institución con el uso de Internet como medio de comunicación.

Ahora, el auge de los sistemas basados en Inteligencia Artificial (IA) evoluciona rápidamente y su impacto es inmenso, de ahí la importancia de prevenir y planificar, aseguran los expertos. La IA mal usada ha mostrado, por ejemplo, su capacidad para manipular la opinión de los ciudadanos hasta en una votación.

A fin de garantizar la auditabilidad del funcionamiento del sistema basado en IA es necesario analizar las legislaciones en diferentes ámbitos e identificar cómo podrían ser, desde ya, utilizados adecuadamente.

Expertos, gobiernos y organizaciones coinciden en la importancia de regular la Inteligencia Artificial. El interés que ha generado este tema es porque abarca la educación, la industria, los derechos humanos, la democracia, el Estado de derecho y la libertad de expresión, entre otros ámbitos.

Regularla contempla las dos caras de la moneda: su aportación y beneficios hacia la humanidad, así como sus riesgos. Los desafíos serán prevenir, regular y establecer normas para proteger a la población. El papel de los gobiernos y los legisladores es inminente para fomentar el uso responsable de las tecnologías.

Iniciativas en la antesala

Si bien la regulación de la inteligencia artificial es un proceso dinámico, en constante evolución, que requiere la participación de todos los sectores involucrados para garantizar el uso eficaz, positivo y de beneficio a la humanidad, existen ya iniciativas y propuestas de regulación de la Inteligencia Artificial a nivel mundial y nacional.

La OCDE se pronunció y proporcionó directrices en la materia firmadas por 36 países, incluido México, en mayo de 2019. Aportan principios para el desarrollo responsable de la Inteligencia Artificial: transparencia, solidez, seguridad, responsabilidad, justicia, equidad y determinación humana.

En el Congreso de México, una de estas iniciativas la presentó el diputado Ignacio Loyola Vera (PAN) (1), en abril de 2023: Ley para la regulación ética de la Inteligencia Artificial para los Estados Unidos Mexicanos. Busca crear estructuras y estándares éticos para la creación, investigación y uso de la AI en México, así como un Consejo Mexicano de Ética para la Inteligencia Artificial y la Robótica.

Durante el foro “Hacia una regulación de la Inteligencia Artificial”, que se realizó el 23 de octubre en Palacio Legislativo de San Lázaro, los diputados participantes e invitados abordaron varias de estas incógnitas y puntos a analizar ante el uso, riesgos y peligros de la IA.

Al respecto, el diputado Ignacio Loyola Vera comentó que el objetivo de su iniciativa es expedir una ley que contemple tres capítulos y 19 artículos. Externó su convicción de que en México existe talento para generar los propios códigos y obtener productos que se puedan patentar. Se podrán generar ingresos mucho más altos que el petróleo, “así que también deberá haber un programa que se llame Sembrando ideas, para que esas ideas generen recursos”.

Por su parte, la senadora Alejandra Lagunes Soto Ruiz (PVEM) consideró que antes de regular la Inteligencia Artificial en México se tendrá que garantizar la conectividad universal, la inclusión digital y financiera, la educación, impulsar capacidades y confianza digital, así como el Estado de derecho.

La IA depende de la toma de decisiones humanas

Ulises Cortés, catedrático e investigador de la Universitat Politécnica de Catalunya (UPC), quien se dedica a varias áreas de Inteligencia Artificial en el Departamento de Ciencias de la Computación de esa institución, comentó que la IA es una disciplina científica de alto interés social cuyas aplicaciones permiten ampliar las capacidades humanas y aportan gran potencial de transformación desde el punto de vista tecnológico, económico y social. El auge de los sistemas basados en la IA, en particular el uso indiscriminado y su marco legal indefinido, está dando lugar a una gama mayor de aplicación en todos los sectores.

El nuevo modelo de Inteligencia Artificial que permite generar lenguaje escrito como el GPT-3 o el Chat GPT (aplicación de chatbot que se especializa en el diálogo) plantea dudas respecto de si están cambiando el paradigma de la Inteligencia Artificial y sobre la responsabilidad de quienes están desarrollando o implementando sistemas basados en esta herramienta, tanto en el sector privado como en el sector público.

El experto asegura que la polémica que se da por el uso de esta nueva tecnología afecta la productividad, el empleo, la educación, la igualdad de género, la inclusión, el medio ambiente, los derechos humanos y otros sectores a corto y a largo plazo. Por ello “es vital comprender que la tecnología basada en la Inteligencia Artificial no es una entidad autónoma, sino que depende de la responsabilidad y la toma de decisiones humanas”.

Riesgos y posibles efectos negativos

Los impactos reportados de la IA tienen efectos positivos y negativos en el desarrollo sostenible. En el caso de los negativos se ha documentado la forma en que inciden en los grupos marginados, que es el caso de “los afrodescendientes, migrantes y las mujeres; por ejemplo, se les ha negado el acceso a servicios públicos o retirados de programas sociales por decisiones basadas en sistemas que usan Inteligencia Artificial y que han resultado erróneas”, asegura el especialista.

Del lado positivo, sostiene Ulises Cortés, debemos contar con sistemas que proporcionan un soporte de mayor precisión y eficiencia en la toma de decisiones y que ayudan a reducir el número de fallos atribuidos a los seres humanos. Además, hay sistemas que funcionan de manera sistemática o que son capaces de hacer tareas peligrosas para uno.

Los desafíos que se plantean están en la cohesión social, la seguridad o la democracia, debido a que mal usados los sistemas basados en la Inteligencia Artificial han mostrado su capacidad para manipular la opinión de los ciudadanos en una votación. Por ejemplo, en EU se produce un sesgo de discriminación al inducir el consumo de productos innecesarios; como efecto colateral se usan grandes cantidades de recursos naturales, agua y electricidad, por lo que ese consumo masivo contribuye al calentamiento global.

Derechos Humanos y ciberseguridad

Además, por el empleo indiscriminado y no regulado de la IA, los derechos humanos, incluyendo el derecho a la privacidad, pueden ser violados, incluso por empresas multinacionales, añadiendo otra complejidad al problema sin rendición de cuentas y afectar a terceros. Un ejemplo reciente fue cuando la IA se usó para difundir fotografías de niñas y niños promoviendo la pornografía infantil.

El empleo de los sistemas de IA en vigilancia policial, cuyos sesgos han sido evidentes, ha propiciado que un par de empresas multinacionales hayan establecido moratorias para su despliegue y la integración de herramientas basadas en esta tecnología, “sobre todo en las funciones críticas de identificación y selección de objetivos en sistemas de armas, delegando así para el efecto práctico decisiones de vida o muerte a una máquina. Al ser inaceptable, es necesario que se avance en los marcos regulatorios de este tipo de utilización a nivel internacional”.

Regular, trampolín para la innovación

Para garantizar la resiliencia de la democracia y el Estado de derecho ante estas herramientas es necesario, en primer lugar, analizar los marcos legislativos en vigor en diferentes sectores con el fin de identificar cómo podrían ser, desde ya, utilizados en el marco de la Inteligencia Artificial. Por otra parte, es urgente establecer un marco legal y regulatorio adecuado específico que tenga como objetivo proteger los derechos humanos, promover la transparencia de estos sistemas, delimitar la responsabilidad, rendición de cuentas y la reparación de daños a quienes la diseñan, es decir, promover la gobernanza eficiente y democrática en los sistemas basados en IA; en general, de todos los sistemas algorítmicos.

El ingeniero Cortés aclaró que la regulación no debe ser contemplada como una limitación, sino como un trampolín para la innovación que garantiza la aceptación y probable confianza pública, además de que fomenta la diferenciación empresarial. Asimismo, debe crearse un marco claro que fomente la inversión industrial en la investigación con una base legal sólida y a largo plazo.

1 Iniciativa completa: https://bit.ly/41jXQQ1